VGG也称为VGGNet,是一种经典的卷积神经网络架构。VGG的开发是为了增加此类CNN的深度,以提高模型性能。

具体而言,VGG代表视觉几何组;它是具有多层的标准深度卷积神经网络架构。“深”是指由16和19个卷积层组成的VGG-16或VGG-19的层数。VGG架构是突破性的对象识别模型的基础。作为深度神经网络开发的VGGNet在ImageNet之外的许多任务和数据集上也超越了基线。而且,它是最流行的图像识别架构之一。

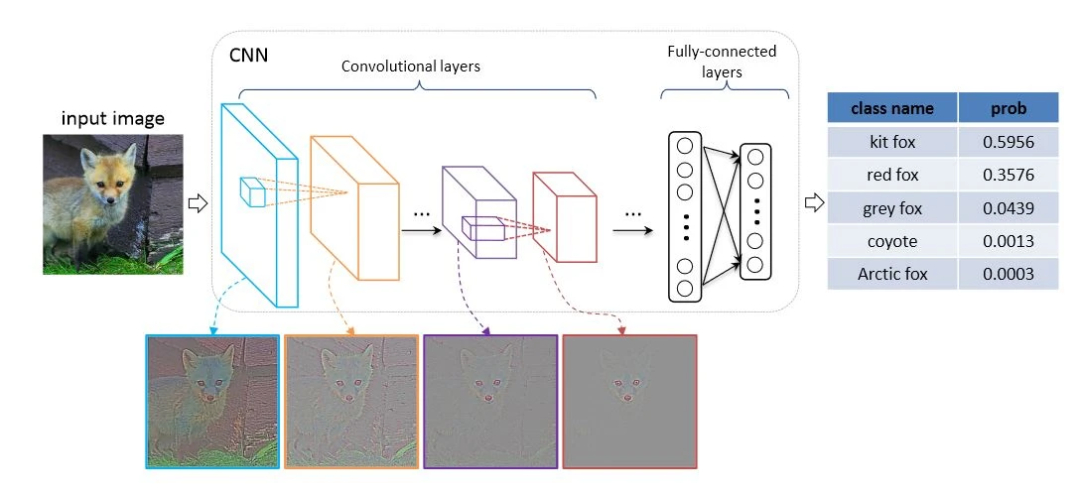

VGG架构VGGNets基于卷积神经网络的最基本特征。VGG网络由非常小的卷积滤波器构成。下图显示了CNN工作原理的基本概念,即图像数据是CNN的输入;模型输出为输入图像提供预测类别。

VGG架构

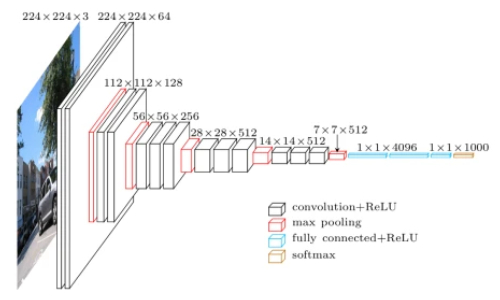

简单看一下VGG的架构:

输入:VGGNet接受224×224大小的图像输入。

卷积层:VGG的卷积层利用最小感受野,即3×3,捕获上/下和左/右的最小可能尺寸。此外,还有1×1卷积滤波器作为输入的线性变换。接下来是ReLU单元,这是AlexNet的一项巨大创新,可减少训练时间。ReLU代表整流线性单元激活函数;它是一个分段线性函数,如果为正则输出输入;否则,输出为零。卷积步幅固定为1个像素,以保持卷积后保留的空间分辨率。

隐藏层:VGG网络中的所有隐藏层都使用ReLU。VGG通常不利用局部响应归一化(LRN),因为它会增加内存消耗和训练时间。此外,它不会提高整体准确性。

全连接层:VGGNet具有三个全连接层。在三层中,前两层各有4096个通道,第三层有1000个通道,每个类1个。

什么是VGG16

支持16层的VGG模型,简称为VGG16,由牛津大学的A.Zisserman和K.Simonyan提出的一种卷积神经网络模型。这些研究人员在题为“用于大规模图像识别的非常深的卷积网络”的研究论文中发表了他们的模型。

VGG16模型在ImageNet中达到了近92.7%的top-5测试精度。它是提交给ILSVRC-2014的最受欢迎的模型之一。它用几个3×3内核大小的过滤器一个接一个地替换了大内核大小的过滤器,从而对AlexNet进行了重大改进。

VGGNet-16可以将图像分类为1000个对象类别,包括键盘、动物、铅笔、鼠标等。此外,该模型的图像输入大小为224×224。

什么是VGG19

VGG19模型也称为VGGNet-19,其概念与VGG16相同,只是它支持19层。“16”和“19”代表模型中的权重层数(卷积层)。这意味着VGG19比VGG16多了三个卷积层。